Cet article a été rédigé au 31/05/2023 et passé en revue le 04/03/2024. Il peut comporter certaines informations non exhaustives en fonction de l’évolution rapide de Chat-GPT par OpenAI. Il fera alors l’objet de plusieurs revues dans le but de rester d’actualité.

Comme le codage ou la programmation peuvent désormais se faire avec un outil de LLM (Large Language Model) et de l’IA générative, de nombreux métiers sont menacés à moyens termes. Le métier de développeur web en fait partie. Comment ne pas succomber à la tentation de remplacer une équipe de devs quand une seule personne sera capable de coder avec Chat GPT?

L’intelligence artificielle fait des progrès considérables depuis plusieurs décennies, au point que de nombreux métiers pourraient disparaître dans un futur proche. L’arrivée du Low Code et du NoCode, avait déjà été un premier tremblement de terre dans le monde du développement web. L’IA générative ressemble maintenant à un véritable tsunami.

Que deviendront les équipes de développement quand une seule personne sachant manier parfaitement l’IA générative suffira pour coder des sites ou des applications ?

I] Chat GPT, l’outil d’IA Générative qui pourrait faire disparaitre le métier de développeur

L’ IA générative progresse si vite que le paysage professionnel pourrait ne plus être celui que l’on connait actuellement. Avec Chat GPT, il est possible de déboguer du code, détecter des failles de sécurité, coder, développer en plusieurs langage de programmation, simuler une machine virtuelle, construire des pages internet, développer des applications…

On peut alors se demander, quelle est la place d’un développeur web quand un outil open source et gratuit peut tout faire à sa place ?

1.Chat GPT permet de générer du code sans connaissances réelles en développement web.

C’est un outil conversationnel capable de générer du code très rapidement, et de développer un programme dans n’importe quel langage de programmation. Il est parfaitement adapté pour créer des briques de développement relativement simples, dès lors qu’on lui impose un prompt bien cadré. Comme il s’agit d’un chatbot, tout le monde ou presque comprend leur fonctionnement, il est donc à la portée de tous.de pouvoir l’utiliser.

2. Chat GPT peut être utilisé pour créer un site internet ou une application mobile

Avec un prompt bien cadré, on peut pousser Chat GPT à aller encore plus. Les exemples sur le net fleurissent, et ce n’est plus un secret, Chat GPT peut coder en JAVA, en HTML/CSS ou encore en Python à l’aide d’une clé API OpenAI.

Cependant, il est rare que la première copie soit parfaitement aboutie. Pour autant, il est tout à fait possible de le retravailler sans être développeur web. Il est même possible de lui demander de réviser du code en cas d’incident technique. Il est aussi possible de lui demander de reformuler ses réponses et ce, autant de fois que nécessaire. Au final, vous pourrez avoir le luxe de choisir entre plusieurs versions de codes générés, sans que vous n’ayez de connaissance spécifique en codage ou en programmation.

Concernant le développement d’application web ou mobile, il est tout à fait possible d’utiliser Chat GPT en le pluggant à d’autres API pour créer des applications plus sophistiquées. En installant par exemple le plugin WebChatGPT sur votre navigateur, vous pourrez obtenir des résultats de recherche prenant en compte l’actualité, et donc, les techniques de code actuelles sans être bloqué à l’année 2021 comme c’était le cas avant.

Ces améliorations sont régulièrement apportées par OpenAI et sont mêmes cruciales pour que cet outil reste la référence des LLM (Large Language Model) et d’IA générative.

Open AI a d’ailleurs développé une autre application de génération d’images à partir d’un prompt appelée DALL-E 3, une alternative à une autre célèbre IA open source : MidJourney. En combinant les deux IA qui sont désormais compatibles (Chat-GPT et DALL-E 3), vous pourrez donc créer du code, du texte et des images pour vos réalisations, sans connaissance spécifique en copywriting, en codage et en graphisme.

3. Les développeurs ont des connaissances limitées, Chat GPT non

Bien que les développeurs aient de solides connaissances en codage et en programmation, il n’est pas comparable à un modèle de langage de type LLM.

Cette technologie est entrainée sur de vastes ensembles de données et de textes. Elle engrange des millions et des millions des données tous les jours pour affiner les réponses aux requêtes qu’on lui adresse.

Ceci représente des milliards de mots et de combinaisons. Ainsi, Chat GPT a pu apprendre des modèles statistiques de la langue pour répondre de la façon la plus humaine et précise possible aux questions qu’on lui pose.

C’est l’une des raisons pour lesquelles Chat GPT peut d’ailleurs répondre à des questions liées au codage ou à la programmation, et ce, dans de nombreux langages de programmation si ce n’est tous, .qui peuvent parfois demandées davantage de connaissance pour un développeur web qui ne les maitrisent pas tous dans son travail.

4. Chat GPT à une puissance de calcul et une rapidité d’exécution que l’homme ne peut égaler

Sa capacité de restitution de l’information, ajoutée à sa capacité de reformulation, puis de restitution des réponses sont inégalables pour l’homme.

Outre le fait que Chat GPT puisse répondre aux questions de la manière la plus humaine et la plus structurée possible aux requêtes qu’on lui adresse, sa capacité à trouver une réponse à tous les sujets existants est surhumaine.

Il ne lui faut pas plus d’une minute pour répondre d’une manière plus ou moins précise à n’importe quelle question, à n’importe quel sujet. Sa base de connaissance n’est pas tout à fait « infinie », mais le champ des possible semble déjà l’être pour cette IA, surtout pour GPT4 qui surclasse déjà de très loin GPT3.

Pour information, Chat GPT 3 prends en compte 175 milliards de paramètres.

Derrière tout ça, il y a Microsoft, avec un investissement initial d’un milliard de dollar en 2020 dans la société OpenAI, essentiellement pour créer de toute pièce un super ordinateur de classe mondiale, et dans le but de lui donner la puissance de calcul nécessaire à sa création, et à son entraînement.

Aussi, la socle Azure du géant américain donnera à OpenAI une base solide pour se développer et arriver à lancer GPT4.

En 2023, le célèbre média Bloomberg annonce que Microsoft investira très prochainement 10 milliards de dollars dans OpenAI pour accélérer ses travaux en IA.

II] Chat GPT est à l’aube d’une révolution technologique, mais…

Les LLMs comme Chat GPT se multiplient, mais sont confrontées à quelques problèmes techniques, juridiques et éthiques. Voici quelques pistes pour que vous compreniez quelles sont ses principales pistes d’amélioration :

1. Il faut fixer un cadre pour garantir un traitement de la donnée qui soit vertueux.

Les LLMs peuvent effectivement avoir des conséquences sur la confidentialité et la sécurité des informations sensibles telles que le secret médical, le secret industriel et le secret gouvernemental. Étant donné que ces modèles ont la capacité de générer des textes qui peuvent être très convaincants, ils pourraient potentiellement outrepasser les limites de confidentialité et de sécurité.

Cela peut être fait en limitant l’accès à ces modèles et en appliquant des règles et des réglementations pour leur utilisation, en particulier pour les organisations gouvernementales et les entreprises. Les chercheurs et les développeurs de LLMs ont également la responsabilité de prendre en compte les implications éthiques de leur travail et de s’assurer que ces modèles sont utilisés de manière responsable.

2. Chat-GPT exploite internet dans sa globalité, avec ses travers, pour apporter les réponses les plus « probables »

Les LLMs comme Chat GPT peuvent reproduire des biais existants dans les données sur lesquelles ils sont formés, ce qui peut potentiellement causer des préjudices à des groupes de personnes marginalisées ou discriminées dans la société.

Il s’est par exemple avéré que Chat GPT venait piocher de l’information dans Twitter, notamment en prenant en compte les commentaires de tout internaute répondant à des tweet, et reprenant donc toutes les dérives que nous pouvons retrouver sur les réseaux sociaux, comme l’a révélé Elon Musk dans un tweet.

On retrouvera plus tard ce même Elon Musk accompagné de centaines d’experts mondiaux tels que le co-fondateur d’Apple Steve Wozniak qui ont signé récemment une lettre du Future of Life Institute appelant à une pause de six mois dans la recherche sur les intelligences artificielles plus puissantes que Chat-GPT 4, le modèle d’OpenAI, pour prévenir « des risques majeurs pour l’humanité« . Peut-être une façon de gagner du temps afin de développer propre projet de LLM initialement nommée TruthGPT, puis xAI et son chat nommé Grok ?

Elon Musk, ancien membre de OpenAI, semble être aujourd’hui en complet désaccord avec l’orientation de la société fondatrice de ChatGPT, puisqu’Elon Musk a récemment porté plainte contre Sam Altman.

Cette plainte porte sur le fait que l’origine de l’entreprise dans laquelle il faisait partie ne devait être qu’une organisation de recherche à but non lucratif pour faire avancer la science à l’aide de l’IA pour l’ensemble des internautes, et non une société ayant pour but de s’enrichir, en se rapprochant de Microsoft…

Les préoccupations grandissantes à propos de l’IA et des LLM ont d’ailleurs produits des premières réactions notables comme la démission de Geoffrey Hinton ; pionnier de la recherche en intelligence artificiel chez Google.

Il a confié à The New York Times être préoccupé par la tournure que prend l’IA dans le monde actuel et dans le monde de demain.

Il confie lors de cette même interview parue le 1er mai 2023, que « les futures versions de cette innovation pourraient être un risque pour l’humanité« . Il confesse enfin, « regretter sa contribution à ce domaine novateur« .

Au lendemain de cette interview, il confiera dans une nouvelle interview accordé à la BBC que « les chatbots sont effrayants » puis il déclarera de ces chatbots qu’ « en ce moment, ils ne sont pas plus intelligents que nous, pour autant que je sache. Mais je pense qu’ils le seront bientôt. »

Ces modèles LLM suscitent aujourd’hui des débats sur les implications éthiques et sociales de l’automatisation de la production de texte, et donc de code, et plus largement, sur la façon dont nous devrions utiliser cette technologie. Comme une IA n’est pas tenue par le secret professionnel, il se pose très sérieusement la question de l’IA Ethique.

3. Chat GPT face aux secrets industriel, médical, et gouvernemental

Les LLMs peuvent avoir des conséquences sur la confidentialité et la sécurité des informations sensibles telles que le secret médical, le secret industriel et le secret gouvernemental. Ces modèles ont la capacité de générer des textes qui peuvent être très convaincants. ils pourraient potentiellement outrepasser les limites de confidentialité et de sécurité de toutes les organisations..

Un LLM pourrait être utilisé pour générer de faux rapports médicaux ou pour accéder à des informations industrielles confidentielles. Samsung en a notamment fait les frais, en utilisant la plateforme Chat-GPT pour corriger du code source pour l’une de ses applications tout en lui révélant des informations confidentielles, suite aux révélations faites par le célèbre média coréen Economist

Le Machine Learning a donc pris en compte ces informations dans son apprentissage comme de nouvelles variables pouvant être restituées à quiconque viendrait chercher l’information. Samsung a donc bloqué l’utilisation de Chat-GPT sur ses lieux de travail, par craintes de fuites d’informations confidentielles. Cette situation concerne par ailleurs d’autres entreprises de grandes tailles comme Verizon ou encore JP Morgan.

Dans le domaine gouvernemental, un LLM pourrait être utilisé pour contourner les protocoles de sécurité et accéder à des informations classifiées ou pour diffuser de la désinformation via les médias sociaux.

Pour faire face à ces risques, il est important d’avoir des protocoles de sécurité stricts en place pour limiter l’accès à ces modèles et à l’information qu’ils contiennent. Les organisations gouvernementales et les entreprises peuvent également avoir besoin de renforcer leur cybersécurité pour se protéger contre les menaces potentielles liées aux LLMs.

Concernant le secret professionnel, la faille qui existe pour les entreprises sont à la même origine que dans le monde de la cybersécurité, et proviennent d’interventions humaines. Selon une étude menée par Cyberhaven,11 % des données que les employés collent dans Chat-GPT sont confidentielles.

Une entreprise de taille intermédiaire (ETI) divulguerait donc des informations confidentielles à Chat-GPT des centaines de fois par semaine, la problématique étant que Chat-GPT incorpore cette matière dans sa base de connaissances, qui devient alors accessible au grand public.

4. Les utilisations détournées de Chat GPT permettent aux hackers de développer des malwares

Aussi révolutionnaire que soit cette technologie, l’IA générative n’en est qu’à ses débuts. Pourtant, il n’a pas fallu beaucoup de temps aux hackers pour détourner l’usage de Chat-GPT pour créer des malwares.

Dans la version Chat-GPT 3, le code éthique défini par Open AI ne permettait pas de contrer correctement les techniques d’ingénierie sociale des pirates. Quand il était demandé directement à Chat-GPT de hacker ou de pirater, ou de lui soumettre des techniques de piratage informatique, l’IA répondait qu’elle ne pouvait pas servir de réponse pour ce type d’usage. Mais, à force de questions et de requêtes, Chat-GPT 3 finissait bien par fournir des bouts de codes qui permettaient ensuite aux cyberpirates de créer des chevaux de Troie, ou encore, des parties de codes pour mettre en place du phishing.

5. Quelle différence entre intelligence humaine et intelligence artificielle ?

« Nous sommes des systèmes biologiques et ce sont des systèmes numériques. » disait Geoffrey Hinton à propos de l’IA et des chatbots.

Malgré l’immensité des données prises en compte par Chat-GPT, l’intelligence artificielle comporte encore de nombreuses lacunes comparées à l’intelligence humaine. En effet, il reproduit certains biais qui sont présents dans les données qu’il va récupérer sur le net et dans les données qu’il a assimilé.

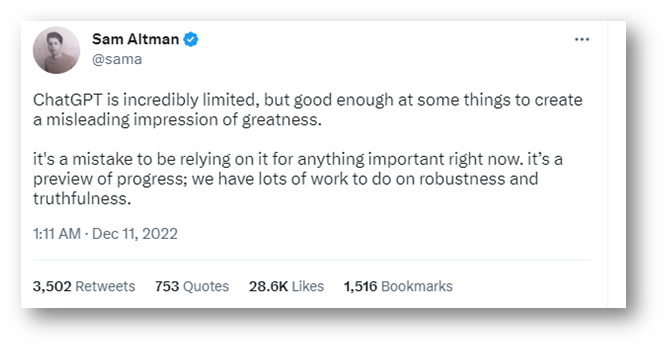

Sam Altman, le fondateur d’Open AI a d’ailleurs révélé dans un tweet publié en décembre 2022 que Chat-GPT était limité, prenant ainsi des pincettes quant à l’exactitude des informations délivrées par le chatbot.

Ces limites, se retrouve sur des exercices de mathématiques, ou encore, sur des sujets médicaux amenant la machine à commettre des erreurs gravissimes si elle se retrouvait à prendre une décision à la place de l’homme.

La principale différence réside donc dans l’intelligence émotionnelle. L’absence d’esprit critique, l’absence de sensibilité ou encore de hiérarchisation de l’information lui fait défaut.

Si vous parliez de votre expertise, et qu’un néophyte en parlait juste après, Chat-GPT ferait une moyenne de vos deux écrits pour en proposer une version qui puisse accorder tout le monde. Le rendu ne sera donc pas à la hauteur.

Les dernières mises à jour de Chat-GPT concernant les mathématiques semblent montrer que le sujet est pris au sérieux, puisque des correctifs ont été apportés pour que l’IA fasse moins d’erreurs. C’est également le cas pour la compréhension du langage Python (Lire release notes 13 février 2024),

Il existe donc de nombreux paramètres pour lesquels Chat-GPT ne peut pas remplacer un « vrai » professionnel, tel qu’un développeur web. Un néophyte pourrait en effet produire du code grâce à Chat-GPT, mais sans savoir ce qu’il produit, il ne pourrait pas l’ajuster au besoin précis d’une entreprise. Bien que Chat-GPT4 se renforce un peut tous les jours grâce aux connaissances emmagasinées par les internautes, et par son entrainement humain, il reste des imprécisions qui ne mettent pas « encore » les professionnels hors-jeu.

III] Pair programming : Chat-GPT est un outil d’aide aux développeurs

Si Chat-GPT ne vole pas la vedette aux experts en développement et programmation, elle est un excellent atout pour les aider dans leur travail. Automatisation des tâches les plus redondantes, révision du code, génération de code modifiable à la marge pour répondre à des développements simples. Et tout cela dans plusieurs langages de programmation.

On parle alors d’un outil de pair programming, comme un couple homme-machine qui travaillent tous deux pour réaliser une tâche ou un ensemble de tâches comme des partenaires de travail.

1. Chat GPT peut générer du code, mais sa qualité dépend du type de langage de programmation, et de la complexité de la tâche.

Chat-GPT est un modèle de langage basé sur l’IA et peut être entraîné sur une grande quantité de données textuelles, y compris du code source. Cela signifie qu’il peut générer du code à partir de textes d’entrée, mais la qualité du code généré peut varier en fonction de la complexité de la tâche et de la qualité des données d’entraînement.

Cependant, l’utilisation de Chat-GPT pour générer du code est destinée aux utilisateurs avancés ayant une connaissance approfondie en programmation. Il est important de comprendre que le code généré peut nécessiter des ajustements et des modifications pour s’assurer qu’il est efficace et fonctionne correctement. Il est donc conseillé d’utiliser Chat-GPT pour générer du code uniquement comme point de départ pour des projets de programmation, et non comme solution finale.

2. Comment Chat-GPT peut-il être utilisé pour résoudre des problèmes de cybersécurité ?

Si Chat GPT peut servir les hackers dans la création de leurs malwares, ou dans l’ingénierie sociale, il peut aussi servir à des causes honnêtes, comme ça peut être le cas dans la cybersécurité.

Comme Chat-GPT compile des informations de manière continue, il intègre comme les hackers un certain historique des cybermenaces du web. Ce qui signifie qu’il peut apprendre à partir de ces données historiques à identifier des comportements suspects et des menaces sur le web. Aussi, il peut servir à avoir une réponse partielle ou complète à des interrogations d’internautes ou d’employés en matière de sécurité numérique.

Une fois bien cadré, il peut détecter des spam et identifier des liens malveillants dans vos e-mails ou dans votre messagerie.

Il est donc possible d’utiliser Chat-GPT comme piste de départ à l’identification de vulnérabilités connues, afin de proposer des mesures de sécurité pour s’en protéger. A partir des cybermenaces étudiées et contrées par le passé, Chat-GPT est donc capable de fournir des pistes connues elles aussi pour se prémunir de certains dangers dans votre réseau, ou plus largement, dans votre organisation.

3. Chat-GPT n’est pas (encore) adapté aux environnements spécifiques

A ce jour, Les environnements les plus techniques et les plus spécifiques ne peuvent être maîtrisés par Chat-GPT. Si Chat-GPT peut se baser sur l’existant, il ne peut pas créer de nouvelles techniques de développement, de nouveaux langages de programmation, et créer de toute pièce des expertises à la place de l’homme. En se basant uniquement sur l’existant, Chat-GPT est également un frein pour les hackers qui ne pourront pas se servir de la technologie de Chat-GPT pour créer des malwares qui n’existent pas encore sur le web.

4. Chat-GPT et ses limites éthiques

S’il est possible de demander à Chat-GPT d’imiter le style rédactionnel d’une société ou d’un être humain, Chat-GPT ne peut se substituer à une personne morale ou physique, par manque de sensibilité ou encore, par manque de personnalisation. Quand nous parlons de « code », cette fois-ci, nous parlons de code de conduite, de code éthique, et de comportement. Un développeur devra donc reprendre du code généré via Chat- GPT pour l’ajuster et l’adapter aux codes d’une entreprise, avec son style, son jargon, son expertise et son esprit critique, mais aussi avec son environnement réglementaire et légal.

C’est d’ailleurs pour cette raison que Bard, l’IA Générative de Google ou encore Claude 2 une autre IA générative, sont encore interdites en France et dans plusieurs autres pays. Car elle ne prend pas en compte les spécificités et les contraintes réglementaires de chaque pays au cas par cas pour en assurer un service parfaitement cadré par les législations nationales propres à chaque pays.

Pour une IA générative 100% frenchy ayant des performances équivalentes aux meilleurs modèles d’IA générative américaines, vous pouvez vous tourner vers « LeChat », le modèle de MistralAI.

5. Reinforcement Learning, ou l’IA entrainée par des humains

Chat-GPT signifie en toutes lettres “Chat Generative Pre-trained Transformer », ce qui peut être traduit par « conversation » et « transformeur génératif pré-entrainé ».

Cet outil est entraîné par des techniques d’apprentissage supervisé et d’apprentissage par renforcement, Deux approches qui font appel à des données créées par des humains pour l’entrainement du modèle dans le but de fournir des réponses les plus adaptés possibles aux requêtes qu’on lui donne. Avec la prise en compte de milliards d’informations prises sur le net mais aussi d’ouvrages en tous genres, Chat GPT utilise également les requêtes des utilisateurs eux-mêmes pour apprendre et fournir des réponses toujours plus adaptées. Les utilisateurs contribuent donc à former Chat-GPT de manière continue.

Conclusion

Chat-GPT est un formidable outil qui va permettre aux développeurs de gagner du temps en automatisant les tâches les plus redondantes, et en servant d’assistant dans la génération de code ainsi que dans la vérification de code. Néanmoins, Chat-GPT n’est pas encore capable de personnaliser la génération de code comme pourrait le faire un développeur « maison ». L’intervention humaine est nécessaire pour que votre code ne soit pas un code lambda, mais bien celui de votre organisation.

Même si des prompts de cadrage sont bien exécutés, et que vous lui demandez de se mettre dans la peau d’une organisation type, Chat-GPT à des limites techniques.

Ces limites ne lui permettent donc pas d’aller piocher de l’information offline ou hébergée ailleurs que sur le net., Il n’est donc pas capable de coder spécifiquement sur des projets uniques et personnalisés pour votre organisation ou pour votre client. Chat-GPT se fiant à l’existant, il n’a pas encore de capacité de prédiction, ni d’aptitude à créer un code qui n’a jamais été développé auparavant.

C’est d’ailleurs pourquoi les hackeurs ont un pouvoir de création de malware limité avec cet outil. Les développeurs on donc intérêt à se servir de Chat-GPT comme assistant, en s’appuyant sur sa puissance de calcul et d’analyse. Pour autant, Chat-GPT dans sa forme actuel n’est clairement pas en capacité de les remplacer. Tant que Chat-GPT reste uniquement un outil conversationnel, il faut de toute façon qu’un développeur échange avec lui, et joue le rôle de contrôle de ce qui est produit par l’IA.

Les développeurs restent encore aujourd’hui indispensables pour la création de logiciels uniques et de qualité, mais peuvent tout à fait se servir d’IA générative comme Chat-GPT ou encore GitHub Copilot Chat pour s’aider dans leurs travaux au quotidien.